Du willst deine Landingpages, Anzeigen und E-Mails fortlaufend optimieren? Dann ist A/B-Testing dein Werkzeug. Mit gezielten Tests findest du heraus, welche Headlines, Call-to-Actions oder Layouts tatsächlich performen. In diesem Artikel zeige ich dir, wie A/B-Testing funktioniert, welche Tools du nutzen kannst und welche Fehler du vermeiden solltest.

Das Wichtigste in Kürze

A/B-Testing ist eine Methode, um zwei Varianten gegeneinander zu testen und datenbasiert zu entscheiden, was besser funktioniert.

- Teste möglichst nur eine zentrale Änderung pro Variante

- Lege Ziel, Hypothese und Messgröße vorab fest

- Zu wenig Traffic oder zu frühe Entscheidungen verfälschen Ergebnisse

Was ist A/B Testing?

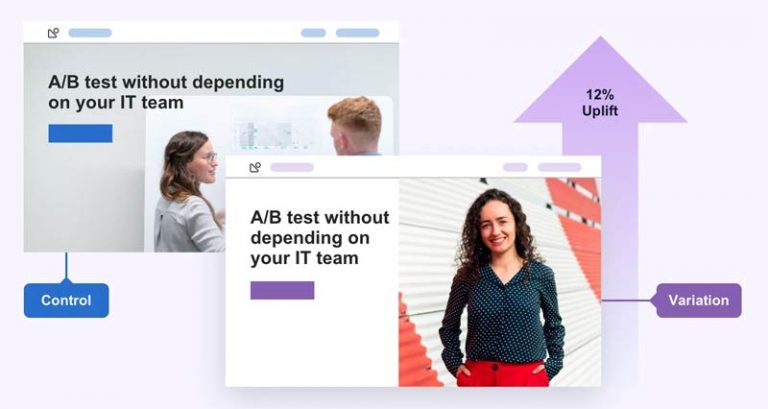

A/B Testing (auch bekannt unter A/B/n Test, AB Test, Split Test, …) ist ein bewährtes Verfahren für direkte Leistungsvergleiche. Das Prinzip: Zwei verschiedene Varianten (z. B. Texte oder Grafiken) ausspielen und prüfen, welche besser performt. Beim „Gewinner“ geht man davon aus, dass dieser den größten Erfolg verspricht.

Besonders verbreitet sind A/B Testings im Performance Marketing und im E-Mail-Marketing. Doch längst werden Online-Experimente auch auf E-Commerce-Shops und Landingpages angewendet.

Wissenschaftlich betrachtet gehört der A/B Test zu den sogenannten Feldexperimenten. Anders als bei Laborexperimenten wird ein A/B-Test unter realen Bedingungen durchgeführt. Er gilt unter Statistikern deshalb als Goldstandard.

Automatisiertes A/B Testing

Online-Experimente sind zeitaufwendig. Im E-Mail-Marketing und in der Online-Werbung haben sich deshalb schon längst automatisierte A/B Tests etabliert: Der Gewinner eines abgeschlossenen Tests wird hier automatisch für die Kampagne verwendet. Zum Beispiel die Betreffzeile einer E-Mail im Rahmen eines Newsletter-Versands. Manuelles Eingreifen ist nicht nötig.

Überwachte A/B Tests

Automation ist längst nicht überall möglich. Am Ende eines überwachten Tests muss der zuständige Marketing Manager bzw. Digital Analyst entscheiden, ob der Gewinner genutzt wird oder zunächst weitere Tests mit neuen Varianten gefahren werden sollen. Überwachte Tests werden häufig auch vorzeitig abgebrochen.

Beispiele für A/B-Tests im Marketing

A/B-Tests lassen sich in vielen Kanälen einsetzen. Typische Beispiele sind:

- zwei verschiedene Betreffzeilen im E-Mail-Marketing

- zwei CTA-Texte auf einer Landingpage

- zwei Varianten einer Anzeigen-Headline

- zwei Formularversionen mit unterschiedlicher Länge

Wichtig ist, dass du nicht alles gleichzeitig änderst. Sonst weißt du am Ende nicht, was den Unterschied verursacht hat.

Vor- und Nachteile von A/B Testing

Vorteile

Ein A/B Test ist mit den entsprechenden Tools relativ „einfach“ umsetzbar. Daraus resultiert jedoch auch ein großes Risiko: Falsch umgesetzte A/B Tests können ein Marketing Team mit einer Vielzahl irreführender „Erkenntnisse“ fluten, die in der Folge zu falschen Entscheidungen führen.

Nachteile

Conversion-Optimierung auf Basis von A/B Testing setzt voraus, dass auf ausreichend viele Live-Daten zurückgegriffen werden kann. Anders ausgedrückt: Je weniger Website Traffic und je weniger Conversions, desto langwieriger und schwieriger sind aussagekräftige Experimente.

Darüber hinaus ist der Weg hin zu einem brauchbaren Testergebnis gesäumt von Fallstricken. Nur wer die alle kennt und mit Widrigkeiten umgehen kann, ist vor Fehlschlüssen gewappnet.

In dem Zusammenhang hier eine Buchempfehlung:

Trustworthy Online Controlled Experiments: A Practical Guide to A/B Testing

Tipps für korrektes A/B Testing

1) Achte auf ein gutes Testdesign!

Ohne korrekte Planung kaum brauchbare Testergebnisse. Lege deshalb viel Wert auf ein gut durchdachtes Testdesign. Dazu gehören Fragestellung nach der zu untersuchenden Einheit und dem zu untersuchenden Segment. Dazu kommt die Festlegung des angestrebten Uplifts, der statistischen Signifikanz und schließlich der Hypothese.

Vereinfachtes Beispiel zur Einordnung von Signifikanz

Bei einem A/B Test sollte der Unterschied mehr als das Doppelte der Quadratwurzel der Gesamtmenge betragen. Beispiel:

A bringt 50.000 Klicks

B bringt 40.000 Klicks

Summe = 90.000

Differenz= 10.000

Die doppelte Quadratwurzel der Summe beträgt 600.

Die doppelte Quadratwurzel der Differenz beträgt 200.

600 > 200

Resultat: Das Ergebnis ist signifikant, d.h. der Test ist aussagefähig – und A ist der Gewinner.

Worauf es bei belastbaren Ergebnissen ankommt

Ein A/B-Test ist nur dann aussagekräftig, wenn du vorab Ziel, Hypothese, primäre Kennzahl, Mindeststichprobe und Laufzeit festlegst. Zu frühes Stoppen, zu wenig Traffic oder mehrere gleichzeitige Änderungen führen schnell zu falschen Schlüssen.

Die Bedeutung von Kundensegmentierung

Experimente sind wenig aussagekräftig, wenn die Struktur der zu untersuchenden User heterogen ist. Du verkaufst, ähnlich wie amazon oder Netflix an alle möglichen Zielgruppen? Dann ist die Bildung von Segmenten unverzichtbar. Mehr zum Thema findest du in diesem Artikel von Yaniv Navot: Segmented A/B tests: Avoiding average experiences

2) Überprüfe jedes Ergebnis!

Korrelation ist nicht automatisch Kausalität. Überprüfe das Ergebnis also immer auf weitere Einflussfaktoren. Lädt eine der Varianten langsamer? Gibt es Differenzen in den Wochentagen? Was ist mit wiederkehrenden Usern? Was ist mit Usern ohne Cookie Consent? Tatsächlich ist die Realität meistens viel komplexer als angenommen. Hilfreich kann zum Beispiel ein sogenannter A/A Test sein.

3) Erspare dir Tests für das eigene Ego!

A/B Testing ist nicht dazu da, eine Meinung durchzusetzen. Testergebnisse dienen allein dem Erkenntnisgewinn. Persönliches Ego und Bauchgefühl haben mit Data-Driven Marketing nichts zu tun.

4) Vermeide Risiken mittels Ramp-ups!

Ist die zu testende Variante mit Risiken verbunden? Dann macht es Sinn, sie vor dem eigentlichen Experiment innerhalb eines kleineren Segments zu testen.

5) Verändere eine Variation möglichst nur an einer Stelle!

Veränderst du in der Variante sowohl eine Headline als auch eine Grafik, weißt du am Ende nicht, was den möglichen Uplift verursacht hat. Zumal sich verschiedene Änderungen auch untereinander beeinflussen können. Teste deshalb möglichst immer nur kleine Änderungen, wenn du etwas lernen möchtest.

Vorsicht

A/B Tests kosten immer Geld. Ganz besonders schlechte Tests, welche potenzielle Kunden von einem Kauf abhalten. Du tust dich schwer mit explorativer Statistik? Dann lass die Finger davon!6) Sei vorsichtig mit Automation von KI-Inhalten!

Immer öfter werden Large Language Models (LLMs) eingesetzt, um Text- und Bildvarianten automatisch zu generieren und einem Test zuzuführen. Das klingt toll, aber geht an den eigentlichen Problemen vorbei. Vor allem aber ist Vorsicht geboten, denn KI kann nicht immer die Qualität einer Variante bewerten. Manuelles Überprüfen ist also weiterhin unverzichtbar.

Viel Potenzial liefert hingegen der Einsatz von Analytical AI. Zum Beispiel im Rahmen prädiktiver Modelle.

Hilfreiche Tools für deine Tests

Für die Optimierung von Webseiten, Shops und Apps mittels A/B Testing wird eine Vielzahl spezieller Tools angeboten. Die Bekanntesten sind Optimizely, VWO, Adobe Target, Convert.com, Kameleoon und AB Tasty. Sie ermöglichen es, verschiedene Versionen von Webseiten, Landingpages oder Apps zu testen, Nutzerverhalten zu analysieren und datenbasierte Optimierungen vorzunehmen. So lassen sich Conversion Rates, Klickzahlen und Engagement gezielt verbessern.

Fazit

A/B-Testing ist kein Hexenwerk, sondern ein mächtiges Werkzeug, um fundierte Entscheidungen zu treffen. Doch Vorsicht: Einen sauberen A/B Test aufzusetzen ist komplexer, als viele wahrhaben wollen. Und nicht korrekt durchgeführte Experimente locken einen auf die falsche Fährte und verschlingen unterm Strich sehr viel Geld.

Häufige Fragen zu A/B-Testing

Was ist A/B-Testing einfach erklärt?

A/B-Testing ist eine Methode, bei der zwei Varianten miteinander verglichen werden, um herauszufinden, welche besser funktioniert. Typische Einsatzbereiche sind Landingpages, E-Mails, Anzeigen oder Formulare. Ziel ist es, Entscheidungen nicht nach Bauchgefühl, sondern auf Basis echter Nutzerdaten zu treffen.

Was kann man bei einem A/B-Test testen?

Mit einem A/B-Test lassen sich zum Beispiel Headlines, Call-to-Actions, Betreffzeilen, Bilder, Formulare, Layouts oder Angebotsdarstellungen testen. Wichtig ist, pro Test möglichst nur eine zentrale Änderung vorzunehmen. Sonst lässt sich das Ergebnis später kaum sauber interpretieren.

Wann lohnt sich A/B-Testing?

A/B-Testing lohnt sich vor allem dann, wenn genügend Traffic oder ausreichend viele Öffnungen, Klicks oder Conversions vorhanden sind. Ohne ausreichende Datenmenge werden Ergebnisse schnell unzuverlässig. Besonders sinnvoll ist A/B-Testing bei Seiten, Kampagnen oder E-Mails mit klarem Optimierungspotenzial.

Wie viele Besucher braucht ein A/B-Test?

Das hängt von Ziel, Conversion Rate, erwartetem Unterschied und gewünschter Sicherheit ab. Grundsätzlich gilt: Je kleiner der erwartete Effekt, desto mehr Daten werden benötigt. Wer zu früh auswertet, riskiert Fehlentscheidungen und feiert am Ende einen Zufallstreffer als großen Durchbruch.

Wann ist ein A/B-Test aussagekräftig?

Ein A/B-Test ist erst dann aussagekräftig, wenn vorab Hypothese, Zielgröße, Laufzeit und Mindeststichprobe sauber definiert wurden. Außerdem sollte der Test lange genug laufen, damit Wochentage, Nutzerverhalten und andere Einflüsse das Ergebnis nicht verzerren. Ein früher Testabbruch ist einer der häufigsten Fehler.

Welche Fehler sollte man beim A/B-Testing vermeiden?

Typische Fehler sind zu kleine Stichproben, mehrere gleichzeitige Änderungen, unklare Hypothesen, falsche Zielmetriken und voreilige Auswertungen. Auch technische Unterschiede zwischen den Varianten, etwa längere Ladezeiten, können Ergebnisse verfälschen. Gute Tests beginnen deshalb nicht im Tool, sondern im Testdesign.

Was ist der Unterschied zwischen A/B-Test und multivariaten Test?

Beim A/B-Test werden meist zwei klar definierte Varianten direkt miteinander verglichen. Ein multivariater Test untersucht mehrere Elemente gleichzeitig und analysiert verschiedene Kombinationen. Für die meisten Teams ist der klassische A/B-Test deutlich einfacher, robuster und im Alltag oft die bessere Wahl.

Welche Tools gibt es für A/B-Testing?

Für A/B-Tests auf Websites und Landingpages kommen häufig Tools wie Optimizely, VWO, AB Tasty, Kameleoon oder Convert zum Einsatz. Im E-Mail-Marketing bieten viele ESPs integrierte A/B-Tests für Betreffzeilen, Inhalte oder Versandzeitpunkte. Entscheidend ist weniger das Tool als ein sauber geplanter Test.

Ist A/B-Testing auch im E-Mail-Marketing sinnvoll?

Ja, gerade im E-Mail-Marketing ist A/B-Testing sehr sinnvoll. Häufig getestet werden Betreffzeilen, Preheader, Versandzeitpunkte, Inhalte oder Call-to-Actions. So lassen sich Öffnungsraten, Klickrate und Conversion gezielt verbessern, ohne gleich die komplette Kampagne auf Verdacht umzubauen.

Kann man auch mit wenig Traffic sinnvoll A/B-Tests durchführen?

Mit wenig Traffic sind klassische A/B-Tests oft schwierig, weil belastbare Ergebnisse lange brauchen. In solchen Fällen kann es sinnvoller sein, größere Hebel statt Mini-Änderungen zu testen oder zunächst qualitative Erkenntnisse zu sammeln. Nicht jeder Optimierungswunsch braucht sofort einen Split-Test.

Ergänzende Artikel

A/B-Tests bringen nur dann wirklich etwas, wenn Hypothesen, Varianten und Auswertung sauber in deine Prozesse eingebaut sind. Ich helfe dir, genau solche Marketing-Automationen mit make.com und passenden Tools praktisch aufzusetzen.

A/B-Testing sauber automatisieren